ChatGPTをはじめとする生成AIがサイバーセキュリティにおよぼす影響と課題

OpenAIの人工知能チャットボット「ChatGPT」が2022年11月に登場してから、生成AI(Generative AI)への注目が高まっています。ChatGPTに代表される生成AIは、書きたい文章を指示(プロンプト)するだけでオリジナルのテキストを生成することができること・日本語を含む多くの言語に対応していること・生成される文章の完成度が高いことからビジネスでの応用が急速に進んでいます。

そこで今回は、生成AIがサイバーセキュリティにおよぼす影響と課題について、弊社も加盟しているCSAのレポートの紹介を交えながらご紹介をします。

CSA『ChatGPTのセキュリティへの影響』

2023年4月24日、弊社も加盟している国際クラウドセキュリティ団体であるCloud Security Alliance(以下、CSA)よりレポート "Security Implications of ChatGPT"(弊社私訳『ChatGPTのセキュリティへの影響』)が発表されました。

- CSA

Security Implications of ChatGPT

https://cloudsecurityalliance.org/artifacts/security-implications-of-chatgpt/(レポートのダウンロードページ) - CSA

Cloud Security Alliance Releases First ChatGPT Guidance Paper and Issues Call for Artificial Intelligence Roadmap Collaboration

https://cloudsecurityalliance.org/press-releases/2023/04/24/cloud-security-alliance-releases-first-chatgpt-guidance-paper-and-issues-call-for-artificial-intelligence-roadmap-collaboration(プレスリリース)

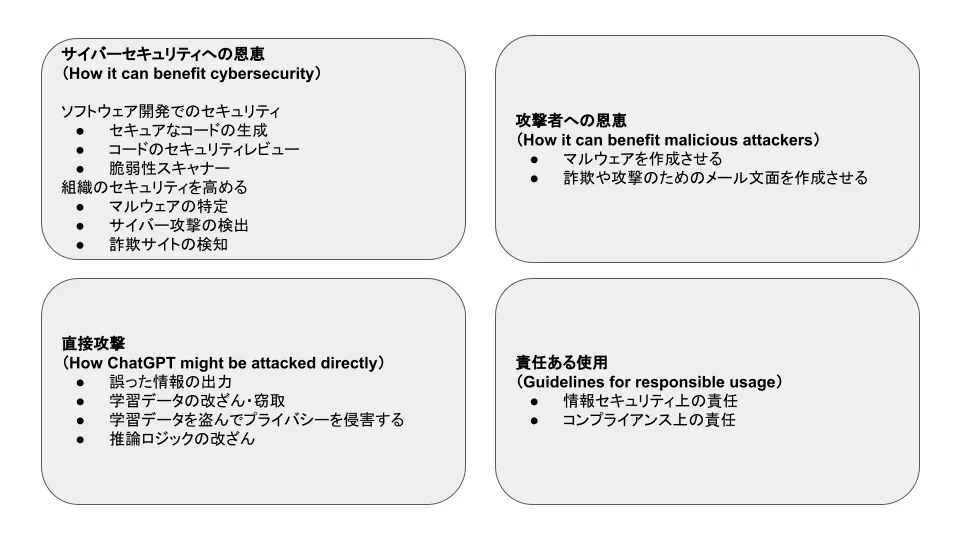

プレスリリースにあるように、このレポートでは、ChatGPTの正の影響と負の影響、すなわち、ChatGPTがセキュリティに活用できる反面、ChatGPTが引き起こすリスクがあることを明確にしています。具体的には以下の4点です。

- ChatGPTがサイバーセキュリティにどのような恩恵をもたらすか(How it can benefit cybersecurity)

- ChatGPTが悪意のある攻撃者にどのような恩恵をもたらすか(How it can benefit malicious attackers)

- ChatGPTがどのように直接攻撃されるか(How ChatGPT might be attacked directly)

- ChatGPTの責任ある使用のためのガイドライン(Guidelines for responsible usage)

これを受けて、今月はChatGPTのサイバーセキュリティへの影響と課題について解説します。そして来月は、この記事から浮かび上がった課題に対して、ChatGPT利用者ひとりひとりが心がけるべきことを、ガイドラインの実例も交えながら解説します。

セキュリティへの恩恵

レポートが示すChatGPTのセキュリティへの影響のうち、プラスになるものは、ChatGPTがサイバーセキュリティに恩恵をもたらしてくれるというものです(How it can benefit cybersecurity)。

セキュアなコードの生成やコードのセキュリティレビュー、脆弱性スキャナーといったソフトウェア開発でのセキュリティや、マルウェアの特定やサイバー攻撃の検出、詐欺サイトの検知といった組織のセキュリティを高めるための用途がこれにあたります。

利用する攻撃者

一方で、攻撃者がChatGPTを使用することも考えられます。

ChatGPTにマルウェアを作成させたり、詐欺や攻撃のためのメール文面を作成させたりすることもできます。ChatGPT自体には倫理面での考慮がされているものの、それをかいくぐるようなプロンプトも開発されています。

ChatGPTそのものへの攻撃

ChatGPTそのものへの攻撃も考えられます(How ChatGPT might be attacked directly)。

たとえば、入力データでChatGPTを騙して、誤った情報を出力させる攻撃(敵対的サンプル攻撃、Adversarial Examples攻撃)や誤分類を誘う目的でChatGPTの学習データを改ざんする(学習データ汚染)、ChatGPTの学習データを盗むことで、個人を特定するなどプライバシーを侵害する(メンバーシップ推論)、ChatGPTに侵入して推論ロジックを改ざんするといったことが考えられます。

ChatGPT利用者のセキュリティ責任

最後に、レポートでは「ChatGPTの責任ある使用」を謳っています。これには、大きく分けて情報セキュリティからの観点とコンプライアンスからの観点があります。

① 情報セキュリティ上の責任

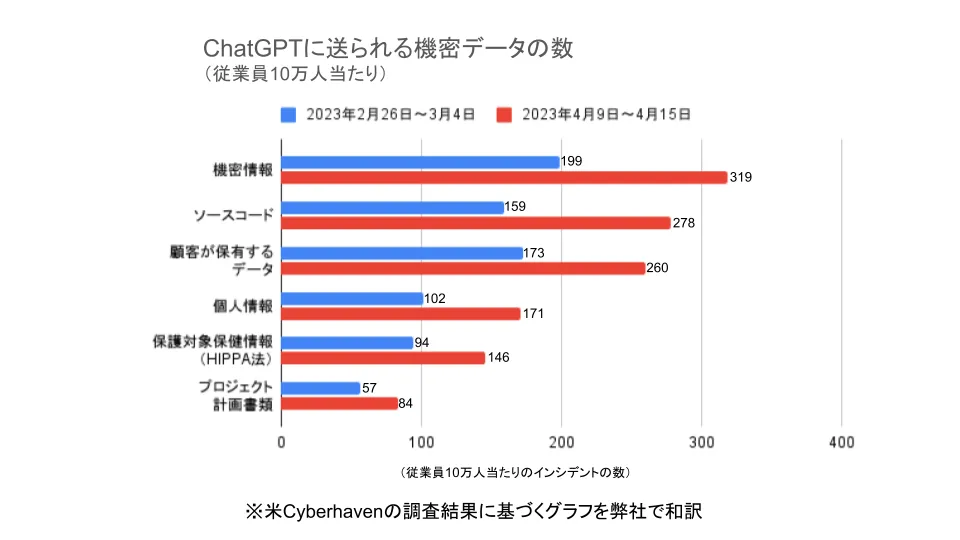

従業員がChatGPTに機密情報を入れて何かあったら心配だ、と考える方は多いと思います。

実際、2023年2月末に公開された米Cyberhavenの調査によると、従業員がChatGPTに貼り付けるデータの11%は機密情報であるとのこと。業務でChatGPTを使う場合、10回に1回は機密情報を貼り付けているという計算になりますから、多いとまでは言えないものの、無視できない数字ではあります。

- Cyberhaven

11% of data employees paste into ChatGPT is confidential

https://www.cyberhaven.com/blog/4-2-of-workers-have-pasted-company-data-into-chatgpt/

こういった情報は盗聴されているおそれがありますし、ChatGPTそのものへの攻撃によって情報が流出するおそれもあります。

② コンプライアンス上の責任

ChatGPTが生成する文章は非常に完成度が高いのですが、その完成度をさらに高めるべく、プロンプトを工夫していくことで、知らず知らずのうちに、契約上第三者に提供してはいけない情報を入力してしまうことがあります。この場合は、実際の情報漏えいにつながったかどうかではなく、行為自体に責任を問われます。

入力だけでなく、出力にもコンプライアンス上の観点があります。たとえば、ChatGPTからの出力を不適切に外部に公開してしまった結果、著作権や商標権の侵害・専門家のレビューを迂回した助言・ChatGPTの出力であることを隠した文章・著しく中立性を欠いた文章や差別的で人権侵害につながる文章などが公開されてしまうということが考えられます。また、ChatGPTからの出力が常に正しいとは限りませんから、間違いを含む情報をさも正しいかのように取り扱ってしまうこともコンプライアンス上の責任につながるリスクです。

セキュリティへの4つの影響から浮かび上がる課題

ChatGPTがサイバーセキュリティに与える影響は4つあることを解説しました。

- ChatGPTがサイバーセキュリティにどのような恩恵をもたらすか(How it can benefit cybersecurity)

- ChatGPTが悪意のある攻撃者にどのような恩恵をもたらすか(How it can benefit malicious attackers)

- ChatGPTがどのように直接攻撃されるか(How ChatGPT might be attacked directly)

- ChatGPTの責任ある使用のためのガイドライン(Guidelines for responsible usage)

このうち、ChatGPTがサイバーセキュリティにもたらす恩恵については、情報セキュリティ担当者の立場ですぐに応用が可能です。そして、情報セキュリティ担当者は、ChatGPTが悪意のある攻撃者に使われることを想定して、対策を立案する必要があります。

ChatGPTが直接攻撃されることについては対策のしようがなく、ChatGPTの責任ある使用と合わせて、情報セキュリティ担当者が組織の全員を巻き込んで考えていく必要があります。

そこで、この項目では、ChatGPTがサイバーセキュリティと悪意のある攻撃者それぞれにもたらす恩恵について、課題を明らかにしていきます。

ChatGPTがサイバーセキュリティにどのように役立てるか

ChatGPTがサイバーセキュリティにどのように役立てるか、という問題に対しては、明確に課題を見つけることができます。

たとえば、コードレビューの際に、機密情報を含まない範囲でChatGPTにレビューを依頼することで、脆弱性がないかどうか、脆弱性のないコードをどう書いたらいいか、といったアドバイスにかかる時間が飛躍的に短縮されます。

また、ログに攻撃の兆候らしきものを見つけたときに、ChatGPTに解析を依頼することで、マルウェアの特定やサイバー攻撃の検出も可能ですし、ChatGPTに疑わしいURLの一覧を渡すことで詐欺サイトを検知し、アクセスを止めるといったこともできるでしょう。

さらに、これらをAPI経由で行う体制を整えることで、Slackなどへの通知や開発・運用の自動化につなげることもできるはずです。

ChatGPTを使う悪意のある攻撃者にどう対抗するか

一方で、攻撃者がChatGPTにマルウェアを作成させたり、詐欺や攻撃のためのメール文面を作成させたりすることで、攻撃のスピードと巧妙さが向上することには注意が必要です。

マルウェアについては、作成のスピードが上がるでしょう。したがって、世の中で出回っている脆弱性情報や情報セキュリティ事案のニュースにはいままで以上に注意を払い、攻撃の前兆をつかんだ場合は素早く対応できる体制を作る必要があります。

一方、詐欺や攻撃のためのメール文面については、たとえば「文面が怪しい」というような見分け方は、今後は通用しなくなるでしょう。ですから、組織の誰かがこういったメールにひっかかってしまうことは今まで以上に避けられなくなるという前提で、万が一詐欺メールや攻撃メールにひっかかったとしても、それをすぐ検知して対応できるか?という観点で体制を整えていく必要があります。

まとめ

CSAのレポート "Security Implications of ChatGPT"(弊社私訳『ChatGPTのセキュリティへの影響』)では、ChatGPTがセキュリティに与える影響としてサイバーセキュリティへの恩恵・攻撃者への恩恵・ChatGPTへの直接攻撃・ChatGPTの責任ある使用のためのガイドラインが含まれています。

情報セキュリティ担当者は、特にChatGPTのサイバーセキュリティへの恩恵を活用するとともに、攻撃者もまたChatGPTを使って攻撃の手を強めてくると心得て、対策を立案、運用していく必要があります。

ご興味のある方は、ぜひお問い合わせください。

.webp)